《奶奶救救我》的一通电话:AI变声“假孙子”设

发布时间:2025-10-30 09:31

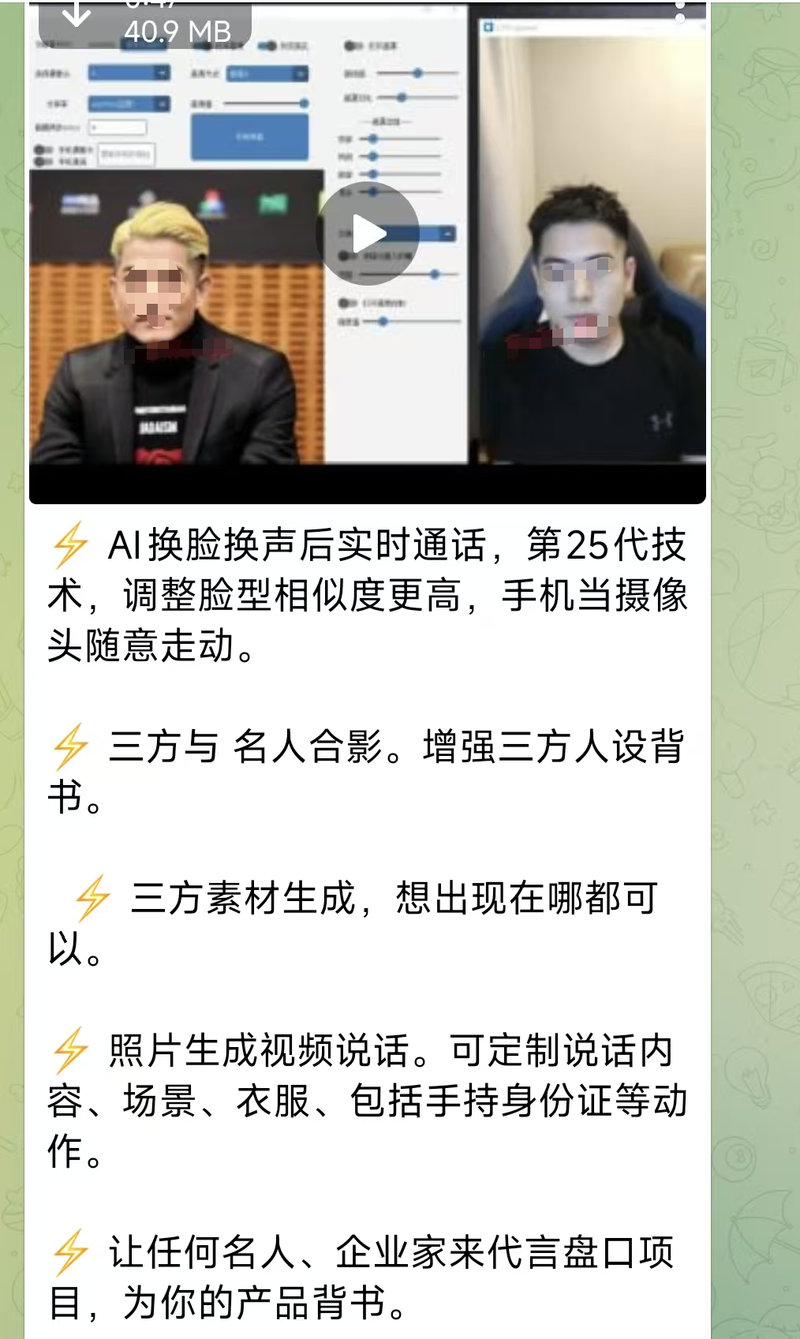

“奶奶,我不小心撞到了人,请不要告诉我的父母,请救救我!”当听到电话那头“孙子”的声音时,来自湖南的刘奶奶慌了。他立即按照对方的指示,去银行提取了3万元现金。按照协议,他把钱交给了村口的“所长亲戚”。这只是一起“AI作弊”案例。在这个数字化风起云涌的时代,人工智能技术就像一把双刃剑。这在带来安慰和变化的同时,也悄然给老年人带来了新的危险和隐患。在语音视频宽恕的技术门槛大幅降低的同时,一些黑灰行业从业者却像狡猾的猎手一样,针对老年人不选择新技术、获取信息有限、容易在情感上依赖亲人的弱点,推出了“步步为营”的“宽恕”服务。新京报贝壳财经记者调查发现,看似高明的伎俩实际上是有AI深度伪造技术支撑的。AI针对老人的“陷阱”主要包括利用深度同理心冒充老人亲属和子女进行钱财诈骗,以及利用AI生成医生、专家的身份,然后通过直播卖货。通过精心制作的虚假宣传视频和山寨,往往会夸大产品的功效,甚至有些新京报贝壳财经记者搜索多个平台发现,不少人以不到1元的价格“打包出售”换脸/语音克隆,这在一定程度上降低了诈骗门槛,海外平台上的黑灰行业从业者也提供从变声到变声的“一站式服务”,价格从十几元到一变不等。一百元哦。北京盈科(合肥)律师事务所合伙人蒋万东在接受新京报贝壳财经记者采访时表示,随着人工智能技术日趋成熟,改变AI面貌不再困难,成为一种新的商业模式。不过,在使用AI进行脸部修饰时,必须严格遵守法律法规。未经许可,利用他人图像或声音素材进行变脸、变声,提供变脸、变声服务和在线教程并收取费用,利用人工智能合成或改变改变权利和肖像权、声音权的视频,可能构成刑事犯罪。 “我的孙子遇到麻烦了,急需用钱。” AI语音改变,面临养老基金目标变化。 “家里的老人接到了电话,电话是老人家的座机打来的,他说是我儿子,而且他的声音和语气据说一模一样,他还说出了他的名字。 “因为他刚刚在路上开车撞到了人,所以就找老人帮忙要钱,并告诉老人,这不是在院子里告诉我们的,他不想让父母知道。”有网友分享了“假孙子”骗局的过程,并称“骗子太可怕了。”此类骗局往往是经过精心策划的。在这位网友的经历中,骗子让一名年轻人到他家收钱,老人后来才意识到。 “诈骗者针对的是80后、90后老人的子女照顾,我们的信息完全暴露。即使孩子们不知道祖父的固定电话号码,骗子也会利用人工智能非常逼真地模仿声音和语气。壳牌财经记者分析爆料和警方案件发现,大多数利用人工智能改变声音、面对甚至假装亲友都是成年人的诈骗者。常见的技巧是使用后r的私人信息被传播,诈骗者利用AI技术创建身份,然后利用“孙子有事,急需用钱”等借口,欺骗亲友,特别是老人。从事网络安全的反诈骗专家吴明(化名)告诉贝壳财经记者,此类诈骗的“起点”往往是泄露用户的私人信息。 “例如,当用户在手机上授权下载未知来源的应用程序时,手机上的通讯录、照片、短信等数据就会被上传到诈骗后台。一旦用户传播或在社交平台上公开分享的语音或视频数据,诈骗分子就可以利用AI技术隔离用户的声音,并将其举报到国内。”交易和社交平台上,发现换脸和换脸相关的服务和教程随处可见。平台上有AI替换角色的教程n个视频一键点击成本不到1元。此类教程通常会提供下载地址和安装说明,甚至有教程称生成图像和视频不像市面上主流的生成机型那样有很多限制,并且提供了“图片去AI”功能。至于克隆AI的声音,presyo不到1元,需要现场克隆的声音“贵了20元”。记者调查发现,不少提供视频、声音制作的黑灰产品卖家并不关心相关视频的用途,而是根据客户需求的难易程度明确标明价格:“换脸换声视频”的制作固定为虚拟货币,折合人民币463元,更换语音约228元,并可“定制”“语音技能”。一些黑灰房产交易渠道还出售与之相匹配的专业诈骗软件es这些技术。 “利用我们手机软件的功能,你还可以直接用手机进行视频通话,可以配合市面上各种变脸的软件使用,让你的‘客户’找不到破绽,你也可以切换到手机上。” ”有黑灰产品卖家表示。黑灰产品卖家宣传信息,“假专家”截图随货出现,“热门代言视频”80元即可定制。有很多针对目标客户的人工智能克隆服务或教程卖家,主要是冒充名人直播卖货。或者认可产品。为了增加相关产品的可信度,一些卖家发布郭富城、巩俐、齐秦等名人为某些公司或产品代言的“代言视频-代言”。买软件可以教操作方法,张雪峰这样的名人也可以制作出来。事实上,随着技术和开源的进步,健全克隆的门槛并不高。 《财经》记者将一段3分钟的个人录音上传到开源软件中,并训练了一个语音模型。虽然在生成长句子时效果有时存在缺陷,但对于一些较短的句子,几乎无法识别合成语音。该开源软件的作者还在用户界面上标注了“该软件是在 MIT 许可下开源的。作者对该软件没有控制权。那些使用该软件并分发该软件导出的声音的人负全部责任”。 10月24日,某视频平台相关负责人向盘壳钱记者表示,利用AI技术进行虚假宣传,已成为互联网广告安全管理的重要挑战。为了保护用户的权益,平台制定了严格的控制政策。例如,要求广告内容必须不包含虚构人物、声称或描述特定身份/姓名/职位角色的存在,或认可产品或服务。如果发现违规行为,广告主将受到广告限制、账号封禁,甚至删除。 10月26日,中国人民大学人口与发展研究院举办“数字时代老年人短视频使用与网络安全”研讨会,并与抖音联合发布了《老年人短视频健康使用指南》,涵盖了短视频平台常见的诈骗案例。其中一种新型诈骗手段是利用AI技术打造老年人信任的身份,如名人、商人、公职人员等,或者与养老金发放、家庭健康、子女命运等相关的信息,刺激老年人点赞、关注、转发。当它通过“情感钓鱼”收集真实用户交互的帐户时,它们会被打包ged 为“优质账户”,然后用于账户销售或参与黑灰活动获取利润。 “利用AI合成‘假专家’或作者人进行商品推销或直播,可能涉及诸多法律法规。根据《中华人民共和国民法通则》,侵犯肖像权、话语权,需要承担制止违法行为等责任,在我国‘一三还’;蒋万东告诉记者。除了“目标”欺诈之外,深度宽恕和检测技术还相互竞争。贝壳财经记者采访基层警方、反诈骗专家、平台监管部门发现,“针对性”诈骗是通过去除老年亲属身份进行的。欺诈过程相当复杂且昂贵。虽然每起案件的成本往往更大,但欺诈案件的总体数量并不像票据欺诈和投资欺诈那么高。另一方面,随着新的AIGC标志规定的出台、通过视频平台改进用户身份验证流程以及破解AI欺诈行为,AI识别“假专家”将变得更加困难。 9月1日,国家网信办等四部门联合印发《关于对人工智能生成的合成内容进行标注的建议》,要求相关平台上传至平台的视频内容,若属于人工智能创作的,必须进行标注。这会让一些“冒充专家”的AI视频失去传播空间。现在,平台能否看出视频是由AI生成的,成为一个很大的挑战。中国信息通信研究院人工智能研究中心安全与元宇宙部主任石林告诉贝壳财经记者,深度宽恕技术和检测技术目前正在相互竞争。 “他们就像e 防病毒和病毒创建。它们是一个攻防对抗的长期过程。现在看来,造假技术确实越来越真实有效了。从今天的研究中我们发现,检测技术在一定程度上会存在一定的滞后性,新算法需要样本积累和过滤。”对于“假孙子”、“假专家”诈骗,海淀市金融管理局发文称,老年人应提高警惕,做好防范措施:在接到不明电话或视频电话时,仔细核实对方身份。可以通过拨打亲友常用电话号码、在视频通话中询问一些私密问题等方式进行核实,等;不要轻易向陌生人透露个人信息、银行账户、密码等敏感信息,同时采取定期更改密码、开启双因素身份验证等安全措施。必须保持诱惑;人们必须对任何承诺高回报的投资或医疗产品保持警惕。请记住“天上的馅饼永远不会掉下来”,高回报往往伴随着高风险。参加“数字时代成人短视频使用与网络安全”研讨会的专家一致认为,应对风险需要多管齐下。要从老年人自身层面增强反诈骗意识和对数字技术的理解,从家庭层面、社会支持层面为老年人提供心理和技术支持。 “老年人只有了解AI一代的技术,才能有识别虚拟人物的意识,从而避免犯罪分子利用虚拟形象制造的骗局。”北京东方老年培训学院院长、北京石景山老年大学原校长杨文霞鼓励老年人要勇于承担责任。o 访问互联网并保持终身学习。中国人民大学人口与健康学院教授唐丹认为,家庭仍然是帮助成年人规避网络危险的第一道防线,但构建家庭防线需要一个漫长的过程,不能操之过急。只要成人使用短视频不对身心健康造成明显伤害,孩子就应该离开成人自由探索的空间,并在日常互动中及时提供危险预警和认知技巧。新京报贝壳财经记者罗一丹编辑魏英子校对王金玉刘宝庆

“奶奶,我不小心撞到了人,请不要告诉我的父母,请救救我!”当听到电话那头“孙子”的声音时,来自湖南的刘奶奶慌了。他立即按照对方的指示,去银行提取了3万元现金。按照协议,他把钱交给了村口的“所长亲戚”。这只是一起“AI作弊”案例。在这个数字化风起云涌的时代,人工智能技术就像一把双刃剑。这在带来安慰和变化的同时,也悄然给老年人带来了新的危险和隐患。在语音视频宽恕的技术门槛大幅降低的同时,一些黑灰行业从业者却像狡猾的猎手一样,针对老年人不选择新技术、获取信息有限、容易在情感上依赖亲人的弱点,推出了“步步为营”的“宽恕”服务。新京报贝壳财经记者调查发现,看似高明的伎俩实际上是有AI深度伪造技术支撑的。AI针对老人的“陷阱”主要包括利用深度同理心冒充老人亲属和子女进行钱财诈骗,以及利用AI生成医生、专家的身份,然后通过直播卖货。通过精心制作的虚假宣传视频和山寨,往往会夸大产品的功效,甚至有些新京报贝壳财经记者搜索多个平台发现,不少人以不到1元的价格“打包出售”换脸/语音克隆,这在一定程度上降低了诈骗门槛,海外平台上的黑灰行业从业者也提供从变声到变声的“一站式服务”,价格从十几元到一变不等。一百元哦。北京盈科(合肥)律师事务所合伙人蒋万东在接受新京报贝壳财经记者采访时表示,随着人工智能技术日趋成熟,改变AI面貌不再困难,成为一种新的商业模式。不过,在使用AI进行脸部修饰时,必须严格遵守法律法规。未经许可,利用他人图像或声音素材进行变脸、变声,提供变脸、变声服务和在线教程并收取费用,利用人工智能合成或改变改变权利和肖像权、声音权的视频,可能构成刑事犯罪。 “我的孙子遇到麻烦了,急需用钱。” AI语音改变,面临养老基金目标变化。 “家里的老人接到了电话,电话是老人家的座机打来的,他说是我儿子,而且他的声音和语气据说一模一样,他还说出了他的名字。 “因为他刚刚在路上开车撞到了人,所以就找老人帮忙要钱,并告诉老人,这不是在院子里告诉我们的,他不想让父母知道。”有网友分享了“假孙子”骗局的过程,并称“骗子太可怕了。”此类骗局往往是经过精心策划的。在这位网友的经历中,骗子让一名年轻人到他家收钱,老人后来才意识到。 “诈骗者针对的是80后、90后老人的子女照顾,我们的信息完全暴露。即使孩子们不知道祖父的固定电话号码,骗子也会利用人工智能非常逼真地模仿声音和语气。壳牌财经记者分析爆料和警方案件发现,大多数利用人工智能改变声音、面对甚至假装亲友都是成年人的诈骗者。常见的技巧是使用后r的私人信息被传播,诈骗者利用AI技术创建身份,然后利用“孙子有事,急需用钱”等借口,欺骗亲友,特别是老人。从事网络安全的反诈骗专家吴明(化名)告诉贝壳财经记者,此类诈骗的“起点”往往是泄露用户的私人信息。 “例如,当用户在手机上授权下载未知来源的应用程序时,手机上的通讯录、照片、短信等数据就会被上传到诈骗后台。一旦用户传播或在社交平台上公开分享的语音或视频数据,诈骗分子就可以利用AI技术隔离用户的声音,并将其举报到国内。”交易和社交平台上,发现换脸和换脸相关的服务和教程随处可见。平台上有AI替换角色的教程n个视频一键点击成本不到1元。此类教程通常会提供下载地址和安装说明,甚至有教程称生成图像和视频不像市面上主流的生成机型那样有很多限制,并且提供了“图片去AI”功能。至于克隆AI的声音,presyo不到1元,需要现场克隆的声音“贵了20元”。记者调查发现,不少提供视频、声音制作的黑灰产品卖家并不关心相关视频的用途,而是根据客户需求的难易程度明确标明价格:“换脸换声视频”的制作固定为虚拟货币,折合人民币463元,更换语音约228元,并可“定制”“语音技能”。一些黑灰房产交易渠道还出售与之相匹配的专业诈骗软件es这些技术。 “利用我们手机软件的功能,你还可以直接用手机进行视频通话,可以配合市面上各种变脸的软件使用,让你的‘客户’找不到破绽,你也可以切换到手机上。” ”有黑灰产品卖家表示。黑灰产品卖家宣传信息,“假专家”截图随货出现,“热门代言视频”80元即可定制。有很多针对目标客户的人工智能克隆服务或教程卖家,主要是冒充名人直播卖货。或者认可产品。为了增加相关产品的可信度,一些卖家发布郭富城、巩俐、齐秦等名人为某些公司或产品代言的“代言视频-代言”。买软件可以教操作方法,张雪峰这样的名人也可以制作出来。事实上,随着技术和开源的进步,健全克隆的门槛并不高。 《财经》记者将一段3分钟的个人录音上传到开源软件中,并训练了一个语音模型。虽然在生成长句子时效果有时存在缺陷,但对于一些较短的句子,几乎无法识别合成语音。该开源软件的作者还在用户界面上标注了“该软件是在 MIT 许可下开源的。作者对该软件没有控制权。那些使用该软件并分发该软件导出的声音的人负全部责任”。 10月24日,某视频平台相关负责人向盘壳钱记者表示,利用AI技术进行虚假宣传,已成为互联网广告安全管理的重要挑战。为了保护用户的权益,平台制定了严格的控制政策。例如,要求广告内容必须不包含虚构人物、声称或描述特定身份/姓名/职位角色的存在,或认可产品或服务。如果发现违规行为,广告主将受到广告限制、账号封禁,甚至删除。 10月26日,中国人民大学人口与发展研究院举办“数字时代老年人短视频使用与网络安全”研讨会,并与抖音联合发布了《老年人短视频健康使用指南》,涵盖了短视频平台常见的诈骗案例。其中一种新型诈骗手段是利用AI技术打造老年人信任的身份,如名人、商人、公职人员等,或者与养老金发放、家庭健康、子女命运等相关的信息,刺激老年人点赞、关注、转发。当它通过“情感钓鱼”收集真实用户交互的帐户时,它们会被打包ged 为“优质账户”,然后用于账户销售或参与黑灰活动获取利润。 “利用AI合成‘假专家’或作者人进行商品推销或直播,可能涉及诸多法律法规。根据《中华人民共和国民法通则》,侵犯肖像权、话语权,需要承担制止违法行为等责任,在我国‘一三还’;蒋万东告诉记者。除了“目标”欺诈之外,深度宽恕和检测技术还相互竞争。贝壳财经记者采访基层警方、反诈骗专家、平台监管部门发现,“针对性”诈骗是通过去除老年亲属身份进行的。欺诈过程相当复杂且昂贵。虽然每起案件的成本往往更大,但欺诈案件的总体数量并不像票据欺诈和投资欺诈那么高。另一方面,随着新的AIGC标志规定的出台、通过视频平台改进用户身份验证流程以及破解AI欺诈行为,AI识别“假专家”将变得更加困难。 9月1日,国家网信办等四部门联合印发《关于对人工智能生成的合成内容进行标注的建议》,要求相关平台上传至平台的视频内容,若属于人工智能创作的,必须进行标注。这会让一些“冒充专家”的AI视频失去传播空间。现在,平台能否看出视频是由AI生成的,成为一个很大的挑战。中国信息通信研究院人工智能研究中心安全与元宇宙部主任石林告诉贝壳财经记者,深度宽恕技术和检测技术目前正在相互竞争。 “他们就像e 防病毒和病毒创建。它们是一个攻防对抗的长期过程。现在看来,造假技术确实越来越真实有效了。从今天的研究中我们发现,检测技术在一定程度上会存在一定的滞后性,新算法需要样本积累和过滤。”对于“假孙子”、“假专家”诈骗,海淀市金融管理局发文称,老年人应提高警惕,做好防范措施:在接到不明电话或视频电话时,仔细核实对方身份。可以通过拨打亲友常用电话号码、在视频通话中询问一些私密问题等方式进行核实,等;不要轻易向陌生人透露个人信息、银行账户、密码等敏感信息,同时采取定期更改密码、开启双因素身份验证等安全措施。必须保持诱惑;人们必须对任何承诺高回报的投资或医疗产品保持警惕。请记住“天上的馅饼永远不会掉下来”,高回报往往伴随着高风险。参加“数字时代成人短视频使用与网络安全”研讨会的专家一致认为,应对风险需要多管齐下。要从老年人自身层面增强反诈骗意识和对数字技术的理解,从家庭层面、社会支持层面为老年人提供心理和技术支持。 “老年人只有了解AI一代的技术,才能有识别虚拟人物的意识,从而避免犯罪分子利用虚拟形象制造的骗局。”北京东方老年培训学院院长、北京石景山老年大学原校长杨文霞鼓励老年人要勇于承担责任。o 访问互联网并保持终身学习。中国人民大学人口与健康学院教授唐丹认为,家庭仍然是帮助成年人规避网络危险的第一道防线,但构建家庭防线需要一个漫长的过程,不能操之过急。只要成人使用短视频不对身心健康造成明显伤害,孩子就应该离开成人自由探索的空间,并在日常互动中及时提供危险预警和认知技巧。新京报贝壳财经记者罗一丹编辑魏英子校对王金玉刘宝庆 下一篇:没有了